日志分析

1.什么是网站日志,从网站日志里面外面能得到什么?

网站日志:服务器记录了用户在网站上面的一些行为信息

内容包括:访客的IP地址 访问的时间 访问的方式 访问的协议 访问的状态码 访问的页面 访问了页面的大小 访客的操作系统以及使用的浏览器版本及内核

2.如何获取网站日志?

登陆FTP Weblog文件夹 下载

3.常见返回状态码:

200 返回成功 可以正常访问

301 重定向 集中权重

302 临时重定向

304状态码 如果客户端发送了一个带条件的GET 请求且该请求已被允许,而文档的内容(自上次访问以来或者根据请求的条件)并没有改变,则服务器应当返回这个304状态码。简单的表达就是:客户端已经执行了GET,但文件未变化。

403 forbidden 服务器拒绝访问 权限问题 服务器不支持这个脚本运行

404 访问的页面不存在 not found (404错误页面)

500 并发数超了()在某个时段内所允许的大访问数量(15s)

503 服务器宕机(由于超载或进行停机维护)

4.IIS日志各字段讲解#Fields: date time s-sitename s-computername s-ip cs-method cs-uri-stem cs-uri-query s-port cs-username c-ip cs-version cs(User-Agent) cs(Referer) cs-host sc-status sc-substatus sc-win32-status sc-bytes cs-bytes time-takendate:发出请求时候的日期。

time:发出请求时候的时间。注意:默认情况下这个时间是格林威治时间,比我们的北京时间晚8个小时,下面有说明。

s-sitename:服务名,记录当记录事件运行于客户端上的Internet服务的名称和实例的编号。

s-computername:服务器的名称。

s-ip:服务器的IP地址。

cs-method:请求中使用的HTTP方法,GET/POST。

cs-uri-stem:URI资源,记录做为操作目标的统一资源标识符(URI),即访问的页面文件。

cs-uri-query:URI查询,记录客户尝试执行的查询,只有动态页面需要URI查询,如果有则记录,没有则以连接符-表示。即访问网址的附带参数。

s-port:为服务配置的服务器端口号。

cs-username:用户名,访问服务器的已经过验证用户的名称,匿名用户用连接符-表示。

c-ip:客户端IP地址。

cs-version:记录客户端使用的协议版本,HTTP或者FTP。

cs(User-Agent):用户代理,客户端浏览器、操作系统等情况。

cs(Referer):引用站点,即访问来源。

cs-host:记录主机头名称,没有的话以连接符-表示。注意:为网站配置的主机名可能会以不同的方式出现在日志文件中,原因是HTTP.sys使用Punycode编码格式来记录主机名。

sc-status:协议状态,记录HTTP状态代码,200表示成功,403表示没有权限,404表示找不到该页面,具体说明在下面。

sc-substatus:协议子状态,记录HTTP子状态代码。

sc-win32-status:Win32状态,记录Windows状态代码。

sc-bytes:服务器发送的字节数。

cs-bytes:服务器接受的字节数。

time-taken:记录操作所花费的时间,单位是毫秒。

5.分析工具

5.1 光年日志分析工具

5.2 excel表格

5.3爱站工具包日志分析

日志的简单分析

1)注意那些被频繁访问的资源

2)注意那些你网站上不存在资源的请求。常见的扫描式攻击还包括传递恶意参数等:

3)观察搜索引擎蜘蛛的来访情况(看网站的抓取情况)

问题

1、新站刚上线,看看搜索引擎有没有来你网站抓取了;

2、网站收录异常,或者被k,通过日志可以了解搜索引擎是否还有来光顾你的网站;

3、对于网站的问题进行解决,必须要读懂日志;

、基础信息

我们从日志中能够获取哪里基础信息呢?总抓取量、停留时间(h)及访问次数这三个基础信息,可以从光年日志分析工具中统计出来。然后,通过这三个基础信息算出:平均每次抓取页数、单页抓取停留时间。然后用我们的MSSQL提取蜘蛛抓取量,根据以上的数据算出爬虫重复抓取率。

查看搜索引擎蜘蛛爬行总次数

一个网站的收录首先要搜索引擎蜘蛛来到网站爬去才能够实现。通过查看日志能够清楚的看到每天蜘蛛访问网站的总次数有多少,从而大致的判断网站的权重如何。一个高权重的网站,蜘蛛来访的次数相对是较多的,相反,一个低权重的网站,即使有非常庞大规模的内容,蜘蛛来访的次数依旧有限。爬行次数有限,分配的时间和深度也就有限,所以收录也就受到了限制。所以我们的重点就是多提供百度来访我们网站的入口,只有入口多了,访问次数才能得到提升。

平均每次抓取页数=总抓取量/访问次数 单页抓取停留时间=停留时间*3600/总抓取量 爬虫重复抓取率=100%—抓取量/总抓取量

查看爬行榜前十名的页面情况

除了查看蜘蛛总访问次数以及爬行目录的整体情况,剩下一个非常重要的就是查看爬行总页面的情况。我平时分析网站的时候,时常会看到,被蜘蛛爬行前几名的页面都是一些无关紧要的页面,比如B2C购物车链接页面、比如联系我们页面、一些主题中CSS文件,这些页面和文件对排名和收录本来没有实际的帮助,但现实情况是蜘蛛爬行的多,所以就会造成浪费,毕竟蜘蛛来访一个网站的总时间和总爬行次数是一定的,总抓取深度也是一定的,如果时间都浪费在了这些页面上,那么对于重点的内页收录就会受到影响。因此通过日志发现之后,就需要在robots.txt中屏蔽掉,或者在页面meta中屏蔽掉。

查看平均爬行一次的抓取深度

通过日志查看平均一次的抓取深度能有效的了解到网站内部结构的不足。比如百度蜘蛛在某天访问网站总共818次,抓取量是978,那么平均每次抓取的页面数就为1.2页。其实这个数据也是普遍存在的现象,很多网站都存在这样的现象。这充分说明了网站的内部链接做的不足,或者网站结构存在问题,或者是内容出现了高度重复现象,导致蜘蛛来到网站,要么没有什么新发现,要么被结构所阻止,爬行不到新的页面。毕竟,蜘蛛平均在我们网站存在的整体时间是有限的,在这个有限的时间内,如果我们自己设置了障碍,那么蜘蛛就会走掉,是非常可惜的事情。

目录抓取情况

用MSSQL提取出爬虫抓取的目录,分析每日目录抓取量。可以很清晰的看到每个目录的抓取情况

通过日志查看所有被爬行目录的整体情况,能让我们知道搜索引擎爬行多的目录是哪些,是否是我们想要提供给用户的目录。一般可以非常清楚的看到排名前十位的目录,如果这些目录并不是我们重点提供给用户内容的目录,那么就需要做出调整,说明当前的一些目录被多度爬行了,而真正有价值的目录没有被搜索引擎过度重视,要及时发现并找到原因。

第二、时间段抓取

重在分析每日的抓取情况,找到相应的抓取量较为密集的时间段,可以针对性的进行更新内容。同时,还可以看出,抓取不正常情况。服务器是否稳定,是否被攻击

第三,IP段的抓取

每日每个IP的抓取量,同样我们需要看整体,如果IP段没有明显的变化的话,网站升降权是没有多大问题的。因为在网站升权或者降权的时候,爬虫的IP段会更换的。

第四,状态码的统计

在这个之前你需要了解下,HTTP状态码返回值代表是什么。

如果你的网站出现太多的304,那么一定会降低搜索引擎的抓取频率以及次数

4)观察访客行为应敌之策:

1、封杀某个IP

2、封杀某个浏览器类型(Agent)

3、封杀某个来源(Referer)4、防盗链

5)文件重命名作用:

1.对访问时间进行统计,可以得到服务器在某些时间段的访问情况。

2.对IP进行统计,可以得到用户的分布情况。

3.对请求URL的统计,可以得到网站页面关注情况。

4.对错误请求的统计,可以更正有问题的页面。

6.日志分析思路

代码 说明

100 (继续) 请求者应当继续提出请求。 服务器返回此代码表示已收到请求的部分,正在等待其余部分。

101 (切换协议) 请求者已要求服务器切换协议,服务器已确认并准备切换。

2xx (成功)

表示成功处理了请求的状态代码。

代码 说明

200 (成功

Gzip压缩

GZIP是GNUzip的缩写,它是一个GNU自由软件的文件压缩程序。它是Jean-loupGailly和MarkAdler一起开发的。次公开发布版本是1992年10月31日发布的版本0.1,1993年2月发布了版本1.0。

GZIP早由Jean-loup Gailly和Mark Adler创建,用于UNⅨ系统的文件压缩。我们在Linux中经常会用到后缀为.gz的文件,它们就是GZIP格式的。现今已经成为Internet 上使用非常普遍的一种数据压缩格式,或者说一种文件格式。

HTTP协议上的GZIP编码是一种用来改进WEB应用程序性能的技术。大流量的WEB站点常常使用GZIP压缩技术来让用户感受更快的速度。这一般是指WWW服务器中安装的一个功能,当有人来访问这个服务器中的网站时,服务器中的这个功能就将网页内容压缩后传输到来访的电脑浏览器中显示出来.一般对纯文本内容可压缩到原大小的40%.这样传输就快了,效果就是你点击网址后会很快的显示出来.当然这也会增加服务器的负载. 一般服务器中都安装有这个功能模块的。

网站的gzip压缩对网站的收录和权重有没有影响?

官方回复:gzip对收录和权重没有影响。对搜索引擎的影响,是抓取速度会快一些。相反在当前是被提倡的,速度快的网站更能获得用户和搜索引擎的好感,并且在站长平台网站优化建议中也提倡站长使用gzip压缩,提升网站速度。

启用Gzip压缩的好处

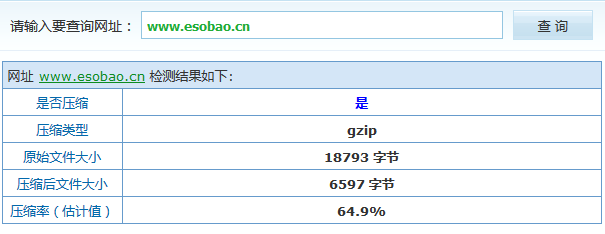

它的好处显而易见,提高网页浏览速度,无论是之前说的精简代码、压缩图片都不如启用Gzip来的实在。下图为启用Gzip后的效果。

网页启用Gzip压缩 提高浏览速度

Gzip压缩效率非常高,通常可以达到70%的压缩率,也就是说,如果你的网页有30K,压缩之后就变成了9K左右。