网站被黑有何影响?

1、网站降权

网站降权是重要的一个影响,因为大多数网站都有数据库和文件备份,所以不可能被黑客全部毁掉网站,所以严重的应该是网站权重下降的问题,一旦网站被黑,网站之前做的所以的关键词排名会迅速下降,甚至没有,而这个恢复时间往往很漫长,特别是对企业影响极大。

2、网站信誉下降

如果是一个企业网站,出现了被黑,打开后又有产品,又有赌博之类的,客户自然不敢购买你的产品了,知道的人以为你网站被黑了,不知道的人还以为企业兼职在做赌博。

还很可能被用户举报,从而百度把网站列入不受信任网站,甚至有风险的网站,客户量大量流失。

3、风险提示

后一个就是安全联盟的风险提示,搜索某一个词,在搜索引擎的结果页面中显示红色字样的明显提示—风险网站,打开时还会提醒这是一个风险网站,自然很难让客户相信你这个站点,这样的结果是网站基本没流量,也没关键词排名。

如何判断网站被黑

如果存在下列问题,则您的网站可能已经被黑客攻击:

1、通过Site语法查询站点,显示搜索引擎收录了大量非本站应有的页面。

2、从百度搜索结果中点击站点的页面,跳转到了其他站点。

3、站点内容在搜索结果中被提示存在风险。

4、从搜索引擎带来的流量短时间内异常暴增。

注:site查询结合一些常见的色情、游戏、境外博彩类关键字,可帮助站长更快的找到异常页面,例如“site:www.esobao.com 博彩”

一旦发现上述异常,我们建议您立即对网站进行排查。包括:

1、分析系统和服务器日志,检查自己站点的页面数量、用户访问流量等是否有异常波动,是否存在异常访问或操作日志;

2、检查网站文件是否有不正常的修改,尤其是首页等重点页面;

3、网站页面是否引用了未知站点的资源(图片、JS等),是否被放置了异常链接;

4、检查网站是否有不正常增加的文件或目录;

5、检查网站目录中是否有非管理员打包的网站源码、未知txt文件等。

温馨提示:若直接访问网站时一切正常,但在百度的搜索结果展现了异常的快照内容,这可能是黑客做了特殊处理,只让百度蜘蛛抓取到异常的页面,以此来增加隐蔽性,让站长难以发现;同理,若直接访问网站正常,但从百度搜索结果页进行访问时,出现了异常页面,这是黑客针对百度来源(refer)做了特殊处理。

网站被黑了怎么办?

在这个水深火热的互联网战场上,很多站长都遇到同行业的恶意攻击,黑客入侵等等安全性受到威胁的问题吧。小编当然也不例外,做优化两年多,间间断断的也与黑客斗争了两年多,从初的手无足策到现在的淡然处之,就让小编教你如何去冷静的对网站被黑吧。

首先,我们都知道,遇到了网站被黑,时间就是去先把别人恶意嵌入的代码什么的去掉,其次再来慢慢的寻找服务器或者空间的漏洞,来填补这些漏洞防止下一次再被攻击,而如何去寻找你服务器的漏洞呢,这就要查看黑客是如何进入到你的网站之中的,每一个服务器都会有一个网站的日志,一般保存的时间是一个月内的,你可以把这些网站日志拿出来分析。分析黑客是什么时候来你的服务器的,什么途径以及什么手法来你的网站的。日志这点很重要,这是我们分析网站漏洞的关键。

第二步就是我要说的如何来处理被黑的页面和信息!被黑的页面和信息千万不要盲目的去恢复,去删除。有的时候狡猾的黑客会在你网站里面嵌入隐藏的ASP/PHP程序,你盲目的去删除这些信息,你会发现你找不到下手的地方了。我们要做的就是顺藤摸瓜,找到黑客在我们服务器或者虚拟主机里面留下来的根茎,只有连根拔起才能根本性的解决问题。一般情况可以用安全钩等安全防护软件,来进行代码清理和扫荡,彻底的查出来网站空间所存在的攻击代码。而用杀毒软件查到网站的病毒之后先不忙着删除,一般比较有头脑的黑客不会简简单单的只留下一个后门,就拿我的网站来说吧,我的站是PHP的我删除了一个病毒之后,原本以为相安无事了。没想到过了1个星期,病毒有出现了,这就是吃一亏长一智啊。正确的做法是,看到网站里面的那个病毒之后。查看那个病毒的修改时间,那么网站根目录里面其他修改时间类似于这个病毒的基本上都会有嫌疑。

查出了对方所留下的病毒和后门,接下来就可以在我们步的网站日志中以这个后门为关键词,查找出来相关的IP段,通过这个IP段来分析黑客是以何种手法来攻击网站的。了解对方详细的入侵过程。因为毕竟只有有漏洞黑客才会利用你的漏洞留下后门来到你的服务器里面进行篡改。现在我们查出了漏洞的所在,及时的去更新或者修补这个漏洞。再把黑客留下的病毒和后门通通杀掉,实现根本意义上的通杀。

后就是修改一切网站、服务器、FTP等文件传输软件的密码,而本人建议好修改服务器的端口,超级管理员密码。毕竟小心驶得万年船嘛。而我们获得的那个IP,网站被入侵的日志分析,提交给当地的网警。接下来的事情交给网警处理就好了。

SEO解决办法

1、直接的方式:关闭网站

百度统计后台有关闭网站的功能,可以直接选择关闭。如果是个人小站还好,但如果是企业站的话,一般直接关闭网站就不太现实了,一旦关闭网站,企业损失一般很大。

2、彻底的方式:启用网站备份文件

在网站被黑之前,我们就要对相应的数据库和文件进行备份,这样能地网站的安全,同时网站遇到被黑的情况时也能很快的恢复网站的运营。

3、网站被黑后,要立马找出黑链,并迅速予以删除。

4、要及时提交死链给百度等主要搜索引擎,在一个404txt文档列出所有的死链,然后上传到FTP空间根目录下,把地址提交给百度即可。

5、Robots文件的设置,把删除的死链的相关文件设置为不允许抓取。

6、坚持一段时间的高质量内容更新。

7、适当找一些高质量的外链。

8、经常更换一下系统管理员的密码,密码要足够强,好是数字、字母和符号的组合。

9、找程序员及时更新网站防木马程序,安装网站安全杀毒软件。有条件建议找专业做网站安全的公司来做安全维护。

10、定期对网站进行安全的检测:

1)分析系统日志、服务器日志,检查自己站点的页面数量、流量等是否有异常波动,是否存在异常访问或操作日志;

2)检查网站文件是否有不正常的修改,尤其是首页等重点页面;

3)网站页面是否引用了未知站点的资源(图片、JS等),是否被放置了外站的异常链接;

4)检查网站是否有不正常增加的文件或目录;

5)检查网站目录中是否有非管理员打包的网站源码、未知txt文件等。

强烈要求:定期做好网站安全监测,这样才能及时发现并解决问题,从而有效降低损失。

11、谨慎上传漏洞

上传漏洞往往是简单也是严重的,能够让黑客或骇客们轻松控制你的网站,可以禁止上传或着限制上传的文件类型,不懂的话可以找你的网站程序提供商。

12、目录权限

请管理员设置好一些重要的目录权限,防止非正常的访问,如不要给上传目录执行脚本权限及不要给非上传目录给于写入权。

13、数据库每天备份一次,文件每周备份一次,当然主要还是根据你网站的更新平率来定,当然也可以借助网站自动备份工具,方便快捷备份你的网站文件和数据库。

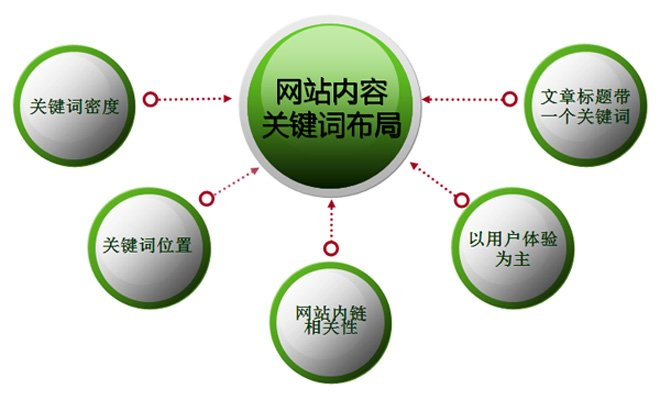

关键词布局策略

对于大多数SEOer来说,做网站优化就是做关键词排名,在关键词优化中,关键词的布局应该是我们seo优化人员应该优先考虑的一点。要想使网站排名稳定上升,必须站内+站外同步做起。竞争力不大的关键词,通过外链便可以把词做起来,再通过高质量的友情链接便可以使排名稳定,至于网站中比较难做、竞争力度很大的关键词就必须从网站的内部开始优化,同时还要从外部建立链接资源。下面是关于网站优化中的关键词布局。

关键词的布局

一、网站整体的关键词布局

当我们拿到一个站时,首先要考虑的就是关键词的布局。其中包含核心关键词,目标关键词,长尾关键词的分布情况。并不是把所有要优化的词都放在首页,什么核心关键词放首页啦,目标词放在栏目页啦,长尾词放在内容页啦,这些都要合理的布局。

二、首页、栏目页的关键词布局

下面我们先来分析一下网站的META标签:title,keywords,description上的关键词布局:

1、title出现的关键词不宜过多,尽量控制在四个之内,主要的关键词放在左边,按照优先级排下去。关键词之间可以通过“-”、“|”、“,”这些符号隔开,效果是差不多的按照个人喜好运用即可。并且核心关键词出现的越早越好。对于中小型网站来说用关键词_网站名称的做法是比较合理的。

2、Keywords,就是关键词,现在的主流搜索引擎都不再依靠中的关键字了,因此,这部分内容我们也只是“例行公事”,个人觉得意义不大,不过总好过没有。

3、Description,就是描述,应该用近乎描述的语言写下一段介绍你网站的文字,在这其中,你应该适当的对你网站的特色内容加以重复以求突出。

4、在页面中多次出现这个关键词,并在次出现时,加粗或者用H1标签进行标注。核心关键词应该尽早的出现在页面中,这样搜索引擎会才会认为这个网页是围绕这个关键词来组织内容的,指导搜索引擎来确定网页的关键词,这里多说一句,搜索引擎并不会直接把keywords中出现的词作为网页的关键词来处理,而是根据网页的内容来提取的。

5、首页关键词注意事项:避免堆砌,有许多站长喜欢在页面底部加上自己网站的核心关键词锚文本,并进行加粗,这点我们认为是不可取的,有不利的嫌疑,虽然搜索引擎不一定这么判定,但是我们要基于用户的角度出发,这里放置这些关键词锚文本用户是不会有点击欲望的,我们可以把核心关键词作为导航或者栏目,形成自然的锚文本,而不是在页面底部进行堆砌。

三、文章页的关键词布局

我们的内页和目录页一般都是用来优化长尾关键词,其实内页的关键词布局和首页基本差不多,首页一般是综合性的,而内页一般都是一篇文章或者产品或者新闻。那么内页的正文部分就要考虑到关键词的布局。一般我们写文章都按照总-分-总的布局来写,那么在总的部分,要集中关键词并加以总结,中间部分的内容围绕着关键词来合理布局,后针对关键词做总结自然的包含了目标关键词。

在此再提醒大家一点:内页部分要在合理的位置放置首页核心关键词的锚文本,一般情况下放且只放置一个核心关键词的锚文本链接到首页,目的是增加首页核心关键词的权重提高首页关键词排名,前提是要合理,不可强行安插,如果文章并没有必要放置的情况下,我们不建议放置这个锚文本。

以上所说的就是个人对关键词布局的总体看法,相信大家也都有自己的一套关键词布局方法。或许有博友会问,总体的布局好了,那平时发布文章时,关键词该怎么布局呢?比如:关键词密度、关键词位置设定等等。跟大家分享一下网站后期关键词布局优化的五点技巧:

一、通过文章编辑,让文章中自然出现关键词

百度搜索引擎和谷歌搜索引擎都在2012年对搜索引擎的算法进行了较大变革,有些网站因为这次变革收录量得到了大幅度的增加,这是对网站内容之前关键词布局的肯定,也是对以后网站关键词布局的一种指导,就是说每一篇容都合理的布局应该出现的关键词密度,让搜索引擎认为文章中的关键词出现是自然的,为网站的关键词进一步优化布局提供有利条件。

二、合理布局关键词出现位置,让关键词被搜索引擎抓取

不同的网站都有着不同的关键词,而合理的布局这些关键词位置就显得尤为重要,对于普通的网站来说,网站关键词出现的位置与网站优化息息相关,对于搜索引擎蜘蛛来说关键词出现的位置应该是有利于抓取的位置,而网站中有利于搜索引擎蜘蛛抓取的位置应该是网站的顶部与左部,可以合理的在这两个方向进行合理的关键词设置,网站关键词被搜索引擎抓取得越多,而其他内容也存在,这就可以为网站提高关键词排名起到促进作用。

三、文章内部链接布局具备相关性,助力网站优化

或许很多站长都做过这件事情,在写文章的时候往往都会出现另外一个网站的链接,而这些网站的链接大多都是不相关的,而这种布局关键词链接就出现了错误,不管是带上的超链接还是纯文本链接,首先关键词就要符合相关性,而链接中指向的内容也必须符合相关性,只有通过加强相关性的方法才能够自己的网站获得搜索引擎的重视,而搜索引擎也会认为你的网站受到了其他站点的支持,这对网站的优化会起到意想不到的作用。

四、以用户为基础编辑网站关键词,创建高效用户体验

网站关键词的选择并不一定要用行业的热门词,真正的关键词应该是符合用户体验为主的词语,比如seo这个词,很多用户在搜索的时候并不一定是搜索seo,而更多的应该是搜索如何学习seo,因此我们在关键词的布局之上就 要像如何学习seo、怎么学习seo进行倾斜,要满足用户的需求,以用户为基础编辑网站的关键词,而不是以自我为中心或者以行业为中心撰写网站关键词。

五、文章标题一定带关键词,但一篇文章好只带一个关键词

很多时候大家写文章都是随便写作,其实真正的文章应该在文章标题中就带上关键词,标题带关键词能够帮助搜索引擎直接抓取关键词,大家都知道搜索引擎在抓取的过程中不一定是将你的文章内容全部抓取,所以我们的标题带关键词就可以为网站的排名提升创造基础,如果你将关键词放在文章内容里面,而搜索引擎又不进行抓取,那么这样的文章是不是就浪费了,写文章的目的是什么?就是为了有排名,有流量。如果连这点都不去关注的话,那就是浪费了文章资源了。

SEO经验之谈:

当网站内容都经过了细致的关键词布局之后,你就会发现网站的收录量逐渐增加,网站关键词排名也会大幅的提高,但有时一些长尾词会有下降的情况,这些起伏都是正常的,不用过多担心。

要注意的是文件的相关性不仅仅是由页面本身来决定的,还有包括链接分析,域名被信任度等等其他因素。

针对关键词的页面优化

关键词密度

网站首页文字不能太多,与关键词相比而言,文字多,不好控制关键词密度,特别是做网站时,一些固定位置的选择,比如导航,栏目,底部,图片属性,这些位置的关键词或许是固定的。好控制的就是文章标题了,如果标题中关键词突出,那密度就突然增高,如果文章标题没有包括关键词,那密度就会低,排名可能也会随着变化。常见的就是cms网站,首页文章多,一般都需要增加关键词密度。

关键词密度控制在2%-8%为佳

关键字密度就是我们所强调的关键词在网页中出现的次数与网页中其它文本内容的比例。相对于页面总字数而言,关键字出现的次数越多,那么总的关键字密度也就越大。关键词密度一般在2%-8%效果为好。既然强调的是次数,那肯定少了说明主题不突出,多了属于关键词堆积。关键词出现在哪些位置能提高关键词排名呢,关键词密度低了高了对排名有什么影响呢。

标题中出现关键词过多真的好吗

我们在选择关键词的时候,都会从标题关键词的设置开展整个页面的关键词设置,很多朋友都认为标题中多放几个关键词效果会好些,能展现在搜索排名中,强调关键词,那是以前搜素引擎不智能,现在搜索引擎看到这些会比较反感,特别是标题堆积一些广泛的词,标题长度过长,导致标题中关键词密度降低,同样得不到好的排名,更不用说流量。标题中同个关键词出现多不要出现3次,且有修饰成分。

比如要设“网站建设”关键字,标题“网站建设,苏州网站建设,苏州网站建设公司”这样网站建设的密度在标题中就很高,且主题突出。标题中不要掺杂其他干扰成分,干脆利落,也不要把长长的公司名称放在后面或者前面,字数越少越好。

关键词与描述标签中的关键词密度也要控制

关键词标签中的关键词也不能太多,可以把标题中的几个关键词作为关键词即可,这个位置可以多放几个,是标题的扩展,可以在放几个与标题相关的长尾词,这个不多说。主要说下描述,描述不是随便放几个关键词就完事,他是一段说明,相当于公司的简介,这个站是做什么的,搜索引擎首先通过它来了解,如果这段描述不出现在搜索引擎搜索排名中标题的下面,说明你设置的就有问题。描述可以把关键词标签设置的几个词放进去,在组成合理的句子,不通顺,少加不需要的词,长度也控制在150字左右。

HTML标签

关键词应该出现在网页标题标签里面,标题标签Title Tag是目前很重要的一个因素,应该包含你重要的关键词。

另外在描述标签Description Tag,关键词标签Keyword Tag,图像ALT标签都可以放入关键词,但注意不要关键词堆砌。

关键词在网页正文中

只要你正常的写文章,关键词必然会出现在文章正文中。好把关键词放在正文标题heading,H1-H3比普通文字有高一点的权重,这也很有逻辑性,因为标题自然是这篇文章应该讨论的内容。

另外可以用黑体,斜体来强调关键词,但一两次就够了。

可以在正文的前面,也就是段句话放入关键词,这也是一个比较重要的因素。

还可以在网页底部放上关键词,当然要符合逻辑和语法,并对用户友好。

URL中的关键词

对英文网页来说,关键词出现在URL中,多少会有点帮助。对搜索引擎相关性算法的帮助可能很小,但其实对用户帮助蛮大的。因为搜索结果列在搜索引擎中时,用户可以从你的文件名就判断出这个网页是讨论什么的。

关键词可以在域名里,也可以在目录名里,也可以是文件名,不过切忌关键词堆砌在URL中。

关键词出现在链接中

关键词应该出现在网页导出链接的链接文字中,这是相当重要的一方面。其实在某种程度上来说,导出链接中含有的关键词,比连向这个网页的外部链接中的关键词还重要。

不仅是在你网站内部互相链接的时候需要以关键词为链接文字,也应该在文章中经常引用和指向其他相关文件,并以关键词为链接文字。