什么是seo ?

SEO(Search Engine Optimization),汉译为搜索引擎优化。搜索引擎优化是一种利用搜索引擎的搜索规则来提高目的网站在有关搜索引擎内的排名的方式。

SEO就是在了解搜索引擎排名算法的基础上,对网站进行站内和站外的优化,对网站存在的弊端加以更正,提高网站关键词在搜索引擎中的排名,获得更多流量与转化率,从而获得盈利。

SEO可分为站外SEO和站内SEO两种。

了解搜索引擎工作原理

站内SEO

站外SEO

排名算法

站长工具

案例分析

搜索引擎工作原理

爬行

抓取

预处理(索引)

排名

搜索引擎自动信息搜集功能分两种。

1、定期搜索,即每隔一段时间,搜索引擎主动派出“蜘蛛”程序,对一定IP地址范围内的互联网站进行检索,一旦发现新的网站,它会自动提取网站的信息和网址加入自己的数据库。

2、提交网站搜索,即网站拥有者主动向搜索引擎提交网址,它在一定时间内(2天到数月不等)定向向你的网站派出“蜘蛛”程序,扫描你的网站并将有关信息存入数据库,以备用户查询。

步:爬行

搜索引擎是通过一种特定规律的软件跟踪网页的链接,从一个链接爬到另外一个链接,像蜘蛛在蜘蛛网上爬行一样,所以被称为“蜘蛛”也被称为“机器人”。搜索引擎蜘蛛的爬行是被输入了一定的规则的,它需要遵从一些命令或文件的内容。

第二步:抓取

搜索引擎是通过蜘蛛跟踪链接爬行到网页,并将爬行的数据存入原始页面数据库。其中的页面数据与用户浏览器得到的HTML是完全一样的。搜索引擎蜘蛛在抓取页面时,也做一定的重复内容检测,一旦遇到权重很低的网站上有大量抄袭、采集或者复制的内容,很可能就不再爬行。

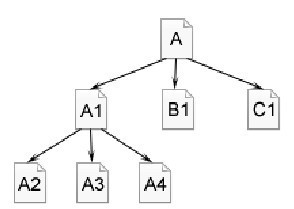

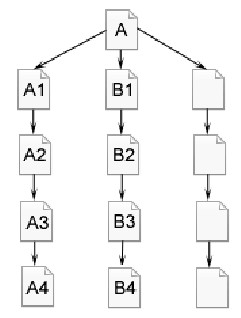

爬行方式

广度优先 深度优先

影响蜘蛛爬行的因素

网站、页面权重高。

网站更新度:蜘蛛每次爬行都会把页面数据储存起来,第二次来的时候发现页面没有变化,就不再抓取。如果页面经常更新,蜘蛛来的也频繁。

导入链接

与首页的点击距离。

是否导出链接过多

是否有网站地图

是否设置404页面

第三步:预处理(索引)

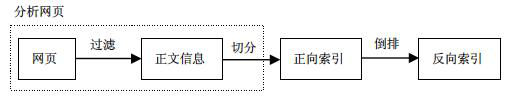

搜索引擎将蜘蛛抓取回来的页面,进行各种步骤的预处理。

1.提取文字(去除格式代码,留文字部分)

2.中文分词

基于词典匹配,词典匹配相对降低,准确性取决于词典的完整性与更新度

基于统计,分析大量的文字样本,统计出字与字相邻出现的概率,几个相邻出现次数越多越可能形成一个词

两种各有优缺点,一般混合使用

3.去停止词

停止词就是那些页面中出现频率很高,却对内容没有任何影响的词,如“的”、“地”、“得”之类的助词,“啊”、“哈”、“呀”之类的感叹词,“从而”、“以”、“却”之类的副词或介词。这些词被称为停止词,因为它们对页面的主要意思没什么影响。搜索引擎在索引页面之前会去掉这些停止词,使索引数据主题更为突出,减少无谓的计算量。

4.消除噪声

绝大部分页面上的一部分内容对页面主题也没什么贡献,比如版权声明文字、导航条、广告等。所以搜索引擎在预处理的过程会把这些无关内容进行消噪处理。

5.去重

同一篇文章重复出现在不同的网站或同网站不同的网址上,搜索引擎不喜欢重复性的内容。

索引前进行识别和删除重复内容;去重方法:选取一部分特征关键词(一般是出现频率高的词),十个左右,计算这些词的数字指纹(MD5算法);特征关键词有任何微小的变化,计算出来的数字指纹都有很大的差距。

6.正向索引

经过以上步骤之后,搜索引擎得到的就是独特的、能反映页面主体内容的、以词为单位的内容。接下来搜索引擎索引过程就是可以提取关键词,按照分词程序划分好的词,把页面转换为一个关键词组成的集合,同时记录每一个关键词在页面上的出现频率、出现次数、格式、位置。这样,每一个页面都可以记录为一串关键词集合,其中每个关键词的词频、格式、位置等权重信息也都会记录在案了。

文件ID | 内容 |

文件1 | 关键词1,关键词2,关键词7,关键词10,…… 关键词L |

文件2 | 关键词1,关键词7,关键词30, ……,关键词M |

文件3 | 关键词2,关键词70,关键词305,……,关键词N |

…… | |

文件6 | 关键词2,关键词7,关键词10,……,关键词X |

…… | |

文件x | 关键词7,关键词50,关键词90,关键词Y |

7.倒排索引

正向索引还不能直接用于排名,因为在搜索某个关键词的时候,排名程序需要扫描所有索引库中的文件,计算相关性,这样的计算量无法满足实时返回排名结果的要求,所以搜索引擎会将正向索引数据库重新构造为倒排索引,把文件对应到关键词的映射转换为关键词到文件的映射,在倒排索引中关键词是主键,每个关键词对应着一系列文件,这些文件中都出现了这个关键词。这样当用户搜索某个关键词是,排序程序在倒排索引中定位到这个关键词,就可以马上找出所有包含这个关键词的文件。

关键词 | 文件 |

关键词1 | 文件1,文件2,文件7,文件58,……,文件 |

关键词2 | 文件l,文件7,文件30,……,文件M |

关键词3 | 文件2,文件70,文件305,……,文件n |

…… | …… |

| 关键词:

没有了!

没有了!

通常来说,在网站的建设过程中,重复内容的产生很难避免,但是重复内容在很大程度上会影响网站在搜索引擎中的表现。今天和大家探讨的内容就是重复内容产生的原因以及解决方法。 产生重复内容的主要原因 1、正文内容越少相似度就会越高,相似度越高网站降权就越严重。主要表现在产品类网站,为什么呢,因为大多数是产品的图片,文字太少。 2、正文的重复文字过多,也会导致相似度过高,那哪些东西会造成相似度过高呢?比如做产品站的,你的够买的流程是不是大多数都是相同的,版权以及联第方式,也是导致页面相似度过高的一个原因。 那我们如何来杜绝呢?如果是做产品的,那么我们把每一个内容页面的图片做一个精准的描述。如果重复内容过多的见意做成图片上的文字来减少页面的相似度。 如果内容过少我们可以这样来做:到互联网上找这个产品针对性的内容然后选取其内容,对我们自己的网页做内容伪原创,如果你是做百度的,你可以去360上去找内容然后把这些内容进行嫁结。如果你是产品类的见意你添加评论。评论你可以去淘宝、阿里上去找以此来减少页面的相似度。 3、网站内容采集,就是内容源。如果你采集的内容跟互联网上的内容相似度过高而你的网站权重又不高,那么百度就会删除你的,解决办法就是(1)内容修改,对你所有采集的内容进行修改,但这个人工是非常大的,所以从一开始我们就做一个健康的网站是多么的重要。(2)修改内页不收录的页面的标题进行修改。 4、网址规范化问题。 网址规范化问题包括主域名的规范化和页面URL地址规范化两个方面,主域名的规范化需要规范化。另外是内页URL的规范化,通常为了让搜索引擎能够的抓取网站内容,我们会将URL进行伪静态处理,而一般的网站伪静态之后,原始的动态URL依然存在并能够访问,这样就造成了多个URL访问相同网址。 5、内容的其他版本 很多网站除了提供正常的版本之外还提供一些其它的浏览版本,比如打印版本或者简版,却并没有禁止搜索引擎去抓取这些页面,而这些页面也因此变成了重复内容页面。 6、网站结构 很多网站在结构设计之初并没考虑SEO方面的因素,结果是导致造成各种页面版本,比如产品按价格,评论,时间排序等,特别是一些电子商务网站,这种页面重复现象尤为严重。 7、URL任意加字符还是返回200状态码。 一些网站是因为网站程序和技术的原因,用户在URL参数后面随意加上一些字符都能够正常访问,并且页面是和没加之前的完全重复。 检查页面是否有重复版本有一个比较简单的方法,就是将内容随机选择一句话加双引号后进行搜索,从结果中就可以看到有多少个重复的页面。因为通常来说随机选一句话进行搜索完全生命的机率是比较小的。 END 重复内容的危害 1很多做SEO的存在一个误区,那就是认为如果网站上有重复内容就会被搜索引擎惩罚,其实倒没有这么严重,搜索引擎会在所有的重复页面中选择一个认为佳的版本去参与排名,其它相似的内容不会同时拥有排名。 2那么问题也就来了,,搜索引擎如何去判断哪个页面是正版的,是否和网站管理员想的页面一致,如果搜索引擎判断失误,把原创的页面当成了复制内容,复制页面当成了原创页面,而你在进行推广的过程中却是原版,那就是做了无用功。第二,同一个网站内的页面存在多个复制内容会分散页面权重,既然页面在网站上出现了,就必然会有链接链向这个页面,而如果链接是统一的,那以全部的权重都可以进行集中,同时相同页面的收录在一定程度上也占用了搜索引擎蜘蛛的抓取精力,减少了原本真正需要进行抓取页面的收录机率。 END 消除复制内容的方法 网址规范化问题好的方法是一个页面只对应一个URL,不要出现多个不同的版本,网站所有链接都指向这个URL。当然有些时候因为程度原来或者其它原因,无法完全统一为一个URL,那么我们可以采用以下三种方式进行集中权重。 1,301重定向 301能够传递页面的权重,目前来说主流搜索引擎都支持301重定向,可以将复制内容的页面全部通过301重定向的方式跳转到原版页面。 2,robots文件禁止 通过在robots.txt文件中禁止复制内容被搜索引擎抓取,也能有效的解决网址重复问题。 3,canonical标签 canonical标签是由谷歌,雅虎在2009年共同发布的一个新的标签,目前百度也表示支持canonical标签,这个标签也可以用于解决网址重复的问题。 添加了以上标签后,也就相当于告诉搜索引擎哪个网址是规范原创的版本,其它复制内容都是指向这一个的网址,有一点页面301传递权重的意思,但是301是页面直接跳转了,而加这个标签后,页面还是停留在原始地址。 |