robots.txt文件详细解说

1. 什么是robots.txt文件?

搜索引擎使用spider程序自动访问互联网上的网页并获取网页信息。spider在访问一个网站时,会首先会检查该网站的根域下是否有一个叫做 robots.txt的纯文本文件,这个文件用于指定spider在您网站上的抓取范围。您可以在您的网站中创建一个robots.txt,在文件中声明 该网站中不想被搜索引擎收录的部分或者指定搜索引擎只收录特定的部分。

请注意,仅当您的网站包含不希望被搜索引擎收录的内容时,才需要使用robots.txt文件。如果您希望搜索引擎收录网站上所有内容,请勿建立robots.txt文件。

2. robots.txt文件放在哪里?

robots.txt文件应该放置在网站根目录下。举例来说,当spider访问一个网站(比如 http://www.abc.com)时,首先会检查该网站中是否存在http://www.abc.com/robots.txt这个文件,如果 Spider找到这个文件,它就会根据这个文件的内容,来确定它访问权限的范围。

网站 URL | 相应的 robots.txt的 URL |

http://www.esobao.cn/ | http://www.esobao.cn/robots.txt |

http://www.esobao.cn:80/ | http://www.esobao.cn:80/robots.txt |

http://www.esobao.cn:1234/ | http://www.esobao.cn:1234/robots.txt |

http://esobao.cn/ | http://esobao.cn/robots.txt |

3. 我在robots.txt中设置了禁止百度收录我网站的内容,为何还出现在百度搜索结果中?

如果其他网站链接了您robots.txt文件中设置的禁止收录的网页,那么这些网页仍然可能会出现在百度的搜索结果中,但您的网页上的内容不会被抓取、建入索引和显示,百度搜索结果中展示的仅是其他网站对您相关网页的描述。

4. 禁止搜索引擎跟踪网页的链接,而只对网页建索引

如果您不想搜索引擎追踪此网页上的链接,且不传递链接的权重,请将此元标记置入网页的<HEAD> 部分:

<meta name="robots" content="nofollow">

如果您不想百度追踪某一条特定链接,百度还支持更的控制,请将此标记直接写在某条链接上:

<a href="signin.php" rel="nofollow">signin</a>

要允许其他搜索引擎跟踪,但仅防止百度跟踪您网页的链接,请将此元标记置入网页的<HEAD> 部分:

<meta name="Baiduspider" content="nofollow">

5. 禁止搜索引擎在搜索结果中显示网页快照,而只对网页建索引

要防止所有搜索引擎显示您网站的快照,请将此元标记置入网页的<HEAD>部分:

<meta name="robots" content="noarchive">

要允许其他搜索引擎显示快照,但仅防止百度显示,请使用以下标记:

<meta name="Baiduspider" content="noarchive">

注:此标记只是禁止百度显示该网页的快照,百度会继续为网页建索引,并在搜索结果中显示网页摘要。

6. 我想禁止百度图片搜索收录某些图片,该如何设置?

禁止Baiduspider抓取网站上所有图片、禁止或允许Baiduspider抓取网站上的某种特定格式的图片文件可以通过设置robots实现,请参考“robots.txt文件用法举例”中的例10、11、12。

7. robots.txt文件的格式

"robots.txt"文件包含一条或更多的记录,这些记录通过空行分开(以CR,CR/NL, or NL作为结束符),每一条记录的格式如下所示:

"<field>:<optional space><value><optionalspace>"

在该文件中可以使用#进行注解,具体使用方法和UNIX中的惯例一样。该文件中的记录通常以一行或多行User-agent开始,后面加上若干Disallow和Allow行,详细情况如下:

User-agent:

该项的值用于描述搜索引擎robot的名字。在"robots.txt"文件中,如果有多条User-agent记录说明有多个robot会受 到"robots.txt"的限制,对该文件来说,至少要有一条User-agent记录。如果该项的值设为*,则对任何robot均有效, 在"robots.txt"文件中,"User-agent:*"这样的记录只能有一条。如果在"robots.txt"文件中,加入"User- agent:SomeBot"和若干Disallow、Allow行,那么名为"SomeBot"只受到"User-agent:SomeBot"后面的 Disallow和Allow行的限制。

Disallow:

该项的值用于描述不希望被访问的一组URL,这个值可以是一条完整的路径,也可以是路径的非空前缀,以Disallow项的值开头的URL不会被 robot访问。例如"Disallow:/help"禁止robot访问/help.html、/helpabc.html、/help /index.html,而"Disallow:/help/"则允许robot访问/help.html、/helpabc.html,不能访问 /help/index.html。"Disallow:"说明允许robot访问该网站的所有url,在"/robots.txt"文件中,至少要有一条Disallow记录。如果"/robots.txt"不存在或者为空文件,则对于所有的搜索引擎robot,该网站都是开放的。

Allow:

该项的值用于描述希望被访问的一组URL,与Disallow项相似,这个值可以是一条完整的路径,也可以是路径的前缀,以Allow项的值开头 的URL 是允许robot访问的。例如"Allow:/hibaidu"允许robot访问/hibaidu.htm、/hibaiducom.html、 /hibaidu/com.html。一个网站的所有URL默认是Allow的,所以Allow通常与Disallow搭配使用,实现允许访问一部分网页同时禁止访问其它所有URL的功能。

使用"*"and"$":

Baiduspider支持使用通配符"*"和"$"来模糊匹配url。

"$" 匹配行结束符。

"*" 匹配0或多个任意字符。

注:我们会严格遵守robots的相关协议,请注意区分您不想被抓取或收录的目录的大小写,我们会对robots中所写的文件和您不想被抓取和收录的目录做匹配,否则robots协议无法生效。

8. URL匹配举例

Allow或Disallow的值 | URL | 匹配结果 |

/tmp | /tmp | yes |

/tmp | /tmp.html | yes |

/tmp | /tmp/a.html | yes |

/tmp | /tmphoho | no |

/Hello* | /Hello.html | yes |

/He*lo | /Hello,lolo | yes |

/Heap*lo | /Hello,lolo | no |

html$ | /tmpa.html | yes |

/a.html$ | /a.html | yes |

htm$ | /a.html | no |

9. robots.txt文件用法举例

例1. 禁止所有搜索引擎访问网站的任何部分 | User-agent: * |

例2. 允许所有的robot访问 | User-agent: * |

例3. 仅禁止Baiduspider访问您的网站 | User-agent: Baiduspider |

例4. 仅允许Baiduspider访问您的网站 | User-agent: Baiduspider |

| 关键词:

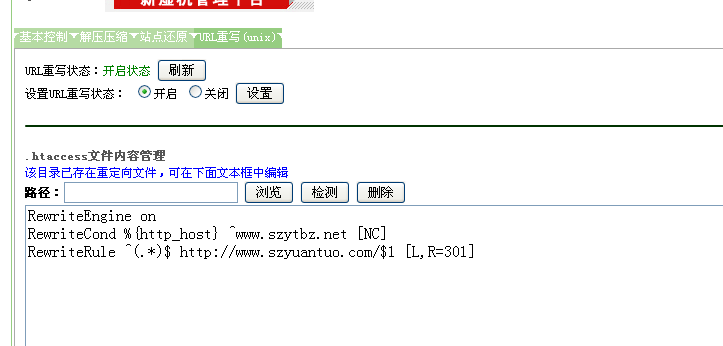

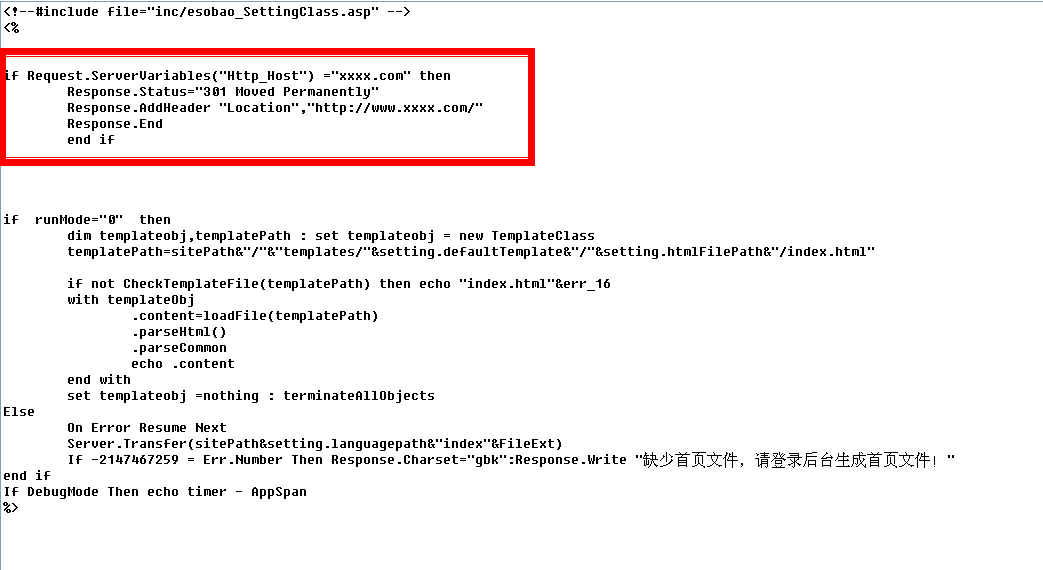

网址规范化 之 301转向: ①:什么是301转向? 301转向又称301重定向、301跳转,是用户或蜘蛛向网站服务器发出访问请求时,服务器返回的HTTP数据流中头信息部分状态码的一种,表示本网址性转移到另一个地址。 另外,还有其他的网址转向方法,例如:302转向、javascript转向、PHP/ASP/CGI程序转向等。这里有个重点:除了301转向外,其他的方法都是常用的作弊手法,虽然方法本身没有对错之分,但被作弊者用多了,搜索引擎对可疑的转向都是非常敏感等。所以,其他的方法还是少用为妙。 ②:301转向传递权重 例如:网页A用301重定向转到网页B,搜索引擎可以肯定网页A性改变地址,或者说实际上不存在了,搜索引擎就会把网页B当作的有效目标。而且,更重要的是:网页A积累的页面权重将被传递到网页B。 举个例子:http://www.esobao.cn/是选定的规范化网址,下面的几个网址都做301转向到选定的规范化网址上,这样搜索引擎就知道它是规范化网址,而且会把这三个网址的权重都传递集中到规范化网址上。 http://maxseo.cn http://maxseo.cn/index.html http://www.maxseo.cn/index.html 可能有站长会问:301转向多久可以生效?一般来说的话,在百度站长工具的改版工具上做下规则提交,大概一周左右就会生效。 ③:怎么样做301转向? 关于怎么做301转向,这里建议参考这篇文章:(http://www.chinaz.com/web/2013/1212/330808.shtml)本篇文章,有详细的301转向操作方法,完全适合个人站长和企业站长。由于文字太长,这里就不写了。 网址规范化 之 canonical标签(参考下百度站长平台给出的标准): ①:canonical标签有什么作用? 对一组内容完全相同或高度相似的网页,通过使用Canonical标签可以告诉搜索引擎哪个页面为规范的网页,能够规范网址并避免搜索结果中出现多个内容相同或相似的页面,帮助解决重复内容的收录问题,避免网站相同内容网页的重复展示及权重的分散,提升规范网页的权重,优化规范网页的排名。 ②:如何用canonical标签指定规范网址? 可通过在每个非规范版本的 HTML 网页的 部分中,添加一个 rel="canonical" 链接来进行指定规范网址。 例如,要指定指向网页 http://www.admin5.cn/product.php?id=15786 的规范链接,需要按以下形式创建 元素: <link rel=”canonical” href=”http://www.admin5.cn/product.php?id=15786”/> 然后将上述链接复制到某网页所有非规范网页版本的 部分中(例如 http://www.admin5.cn/product.php?id=15786&active=1),即可完成设置。 ③:可设置规范网页的几种情况举例: 举例一、社区帖子可能由于置顶、突出颜色等行为导致内容完全相同的一个网页产生不同的链接,搜索引擎只会选择其中一个链接建立索引,如以下两个链接不同,内容完全相同的页面: http://www.a5.net/forum.php?mod=viewthread&tid=17868770&page=1#pid115642474 http://www.a5.net/thread-17868770-1-1.html 举例二、对商品的列表页面,按照价格或者优惠等顺序进行排序,但网页内容高度相似: http://mall.leho.com/pr-list?locid=75fb2a357d38397c5e1e75fa&cid=5e1e02f950a4101fb27571ee&order=discount http://mall.leho.com/pr-list?order=price_asc&locid=75fb2a357d38397c5e1e75fa&cid=5e1e02f950a4101fb27571ee 举例三、网站有多个网页展示的为相同型号的商品,只是每个网页商品图的颜色不同,其他内容几乎完全相似,此时也可设置rel="canonical",将当下流行色彩的商品网页设置规范网页,百度有优先将其显示在搜索结果中。 ④:百度会完全遵守rel="canonical"标签吗? 网页中添加该标签后,就代表站长向百度某个网页作为规范的网页版本,百度会同时根据标签的及系统算法选择出合适的网页将其显示在搜索结果中。百度会根据网页内容实际情况考虑Canonical标签中的网页,但不完全遵守该标签。为了标签的效果,请一个页面中仅有一个Canonical标签。 ⑤:此链接是相对的还是的? rel="canonical" 可与相对链接或链接一起使用,但建议您使用链接,以大程度地减少可能出现的混乱或问题。 ⑥:rel="canonical"标签可用于在不同的域名中建议规范网址吗? 如果网站需要更换域名,且使用的服务器不能创建服务器端重定向网址的情况下,就可以使用rel="canonical" 链接元素指定希望百度收录域的网址。 301 404案例; 页面301处理 if Request.ServerVariables("Http_Host") ="xxxx.com" then Response.Status="301 Moved Permanently" Response.AddHeader "Location","http://www.xxxx.com/" Response.End end if 多域名处理 if Request.ServerVariables("Http_Host") ="xxxx.com" or Request.ServerVariables("Http_Host") ="xxxx.com" then Response.Status="301 Moved Permanently" Response.AddHeader "Location","http://www.xxxx.com/" Response.End end if 下面的情况基本上都是虚拟主机常用配置 新一代数据中心http://gzidc.com/ 301设置

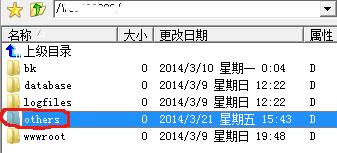

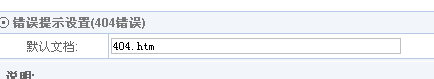

.htaccess 单域名301 RewriteEngine On RewriteBase / RewriteCond %{HTTP_HOST} ^lszygw.com$ [NC] RewriteRule ^(.*)$ http://www.lszygw.com/$1 [L,R=301] 多域名处理 RewriteEngine On RewriteBase / RewriteCond %{HTTP_HOST} ^lszygw.com$ [OR] RewriteCond %{HTTP_HOST} ^linxigang.com$ [OR] RewriteCond %{HTTP_HOST} ^www.linxigang.com$ [NC] RewriteRule ^(.*)$ http://www.lszygw.com/$1 [L,R=301] 404设置 404.Asp 恒爱网络http://www.zzhidc.com/ 301设置 httpd.ini 文件的代码如下 : [ISAPI_Rewrite] CacheClockRate 3600 RepeatLimit 32 RewriteCond Host: ^abc.com$ RewriteRule (.*) http://www.abc.com$1 [I,RP] 如 [ISAPI_Rewrite] CacheClockRate 3600 RepeatLimit 32 RewriteCond Host: ^jnzhipin.net$ RewriteRule (.*) http://www.jnzhipin.net$1 [I,RP] RewriteCond Host: ^jnzhipin.com$ RewriteRule (.*) http://www.jnzhipin.net$1 [I,RP] RewriteCond Host: ^www.jnzhipin.com$ RewriteRule (.*) http://www.jnzhipin.net$1 [I,RP] 把以上内容修改成你自己的之后,把 httpd.ini 上传到你空间网站根目录 wwwroot下 。 用FTP连接到空间,在wwwroot 同级目录建立一个名为 others 的新文件夹,如下图

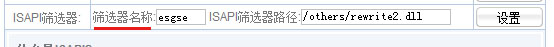

接下来去 http://pan.baidu.com/s/1gd42ZQj 下载ISAP组件,解压之后得到 rewrite2.dll 把 rewrite2.dll 上传到 others 目录里。 然后 登陆到你空间管理后台的 “独立面板”里,找到 “ISAP映射”,点击之后进入添加映射,筛选器名称 随便写个,路径如图所示写路径,然后点击后面的“设置”

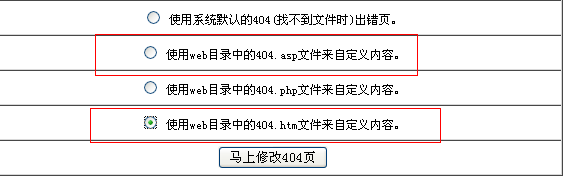

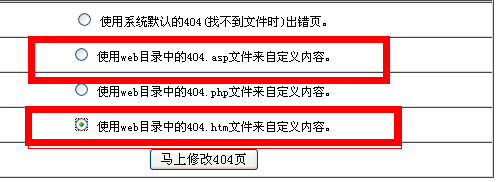

404设置(用404.htm)

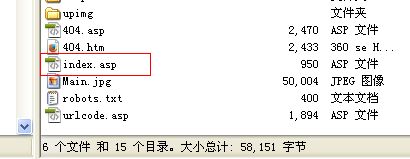

益息网络http://www.idc1.net/ 301设置() 在根目录下有个index.asp文件

if Request.ServerVariables("Http_Host") ="xxxx.com" then Response.Status="301 Moved Permanently" Response.AddHeader "Location","http://www.xxxx.com/" Response.End end if

404设置(根据根目录下的文件设置)

骑士互联http://www.74dns.com 301设置(在根目录下放文件httpd.ini) 文件代码代码 [ISAPI_Rewrite] CacheClockRate 3600 RepeatLimit 32 RewriteCond Host: ^xxxx.net$ RewriteRule (.*) http://www.xxxx.net$1 [I,RP] 404设置(根据网站目录下文件情况)

广深互联http://www.99idc.cn/ 301设置 web.config文件的代码如下 : <?xml version="1.0" encoding="UTF-8"?> <configuration> <system.webServer> <rewrite> <rules> <rule name="CanonicalHostNameRule1"> <match url="(.*)"/> <conditions> <add input="{HTTP_HOST}" pattern="^www.sanyoushun.com$" negate="true"/> </conditions> <action type="Redirect" url="http://www.sanyoushun.com/{R:1}"/> </rule> </rules> </rewrite> </system.webServer> </configuration> 404设置(与骑士一样) |