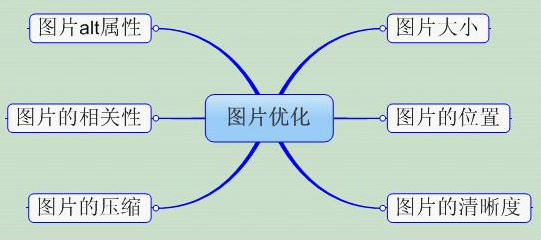

内容图片优化

1,图片的尺寸和大小

图文并茂是百度和用户喜欢的形式,但运用图片的时候应注意图片的大小和尺寸。百度在搜索结果页展示图片的时候,实际上不是所有页面有图就给出显示,展示图片的一个规则就是图片大小接近121:75,站长可以根据此规则调节好图片尺寸。一是给网站服务器减压,第二是不拖累网站的网速,利用用户的点击快速浏览,一般来讲,3秒钟网站页面打不开,你的用户就会离开。

出图原则

①目前站长只需要将图片放在页面主体内容中,百度会进行相应的图片识别及场景识别,后续会提供协议规范;

②图片大小尽量接近121:75;

③图片必须与页面内容紧密相关,如果出现作弊或恶劣低质图片,将有相应的处理机制:

A、屏蔽出图;B、 降低站内url排序;C、严重者整站将受到影响

2,图片清晰度

有时一篇文章的精华就是图片啦,假如一篇“xx结构图”的文章,用户就是想看清楚结构细节,文字再好内容再丰富,如果配图不清晰的话对用户的价值大大打折。

3,图片的alt标签

图片优化alt标签是基础的东西了,基础的也就越重要,在图片上传好之后千万不要忘了alt标签。蜘蛛判断图片内容就是靠alt,但同时也不建议在alt标签里堆砌关键词,用文章标题是个不错的选择。

4,图片的title标签

对比alt标签,title被大多数seo遗忘了,实际上笔者认为这个与alt标签相比同样重要。如下图所示,当用户鼠标停留在图片上时会显示文字,这对用户体验有很大的帮助,同时也会多出现一次关键词。

5,图片周围文字

看上图,这张图片下面有个类似版权申明的文字,百度除了参考alt标签同时也参考周围文字来猜测图片是关于什么的。

6,图片的原创度

百度对原创内容越来越喜欢,大量抄袭对网站有百害而无一益。但大多数seo可能只停留在内容的原创上,实际上图片也是页面的一部分,原创图片无疑是蜘蛛喜欢的。进一步想,如果站长花大量时间制作一张满意的图片,百度也会认为这篇文章的原创度和价值很高。

7,图片本地化或本地储存

虽然原创图片对排名和用户有很大的好处,但花费的时间很多,有时候借用别人的图片也是不错的选择。但我建议在盗用图片的时候好下载到本地再上传到自己的网站。如果直接以链接的方式调用的话等于给别人做了一个外链啦,自己网站权重就分散了。

8,图片文字

图片文字指的是图片上面的文字,这有什么可优化的呢?

图片文字同样有很多值得细心注意的地方,给自己做的图片添加自己网站的水印,防止别人盗用。另外可以在图片上面添加自己公司的名称或者是微信、微博账号增强企业品牌传播。

如同网站SEO优化一样,品牌传播都是一点一点积累过来的,做SEO有自己的品牌很关键。

9,图片的位置

图片出现的位置同等重要,图片信息往往能够让用户及读者直观清晰的映入脑海,因此映入眼帘、充分的展现图片信息必须合理掌握。目前图片的应用率也逐渐加大,以页面内容中展现时,往往布局在主题之前,让用户时间对主题段落有充分的认识,通过图片信息更能够加深印象。其实图片的使用不仅仅展现在内容中,常常使用文章时也会加以利用进行展现,让用户更加直观感受主题含义。

10,图片的压缩

SEO优化过程中往往对图片优化无法做到十全十美,为了进一步对其完善,提高网页加载速率,可以适当考虑采压缩图片。http://jingyan.baidu.com/article/48b558e35605c17f38c09a33.html,减少图片大小,像素不变

百度搜索页走进图文

近两个月大家在百度搜索时会发现一些搜索结果前增加了图片,显然在某些场景下这种展现形式明显提升了用户的检索体验:图片的直观性明显优于文字,用户通过读图可以在短时间内就判断出页面主旨,进而快速进入内容详情页面。

这 在另一方面也提升了图文结果的点击率给站长带来了的收益。因此,有很多站长通过各种方式进行测试或在“Lee on line”活动中进行提问,细心 的朋友会发现在活动中对此也进行了回答。在这里跟大家明确的介绍一下,需要强调的一点是:希望站长不要为了出图文而刻意去做图配图,一定要根据自己的内容 以及用户的阅读及使用场景,在适合的情况下进行优化。

1、目前站长只需要将图片放在页面主体内容中,百度会进行相应的图片识别及场景识别,后续会提供协议规范;

2、图片大小尽量接近121:75;

3、图片必须与页面内容紧密相关,如果出现作弊或恶劣低质图片,将有相应的处理机制:

A、屏蔽出图;B、 降低站内url排序;C、严重者整站将受到影响

每个企业都要拥有自己的网站,但是我们在建设的时候不能盲目,要明确建站的目的,同时还要明确建站的视觉效果和用户体验,明确目标后,才可以建设出一个合适的网站。

1、让用户浏览的时候更加舒适

网站建设一定要找专业的建站公司,这样才可以网站有一个比较好的视觉效果和用户体验,可以让用户在进入网站的三秒钟内有继续往下浏览的欲望,对我们的网站加深印象,让网站的营销转化率提高。

2、具备很高的安全性

专业的网站建设,在制作时纯手写代码,可以有效防止病毒侵入,这样才可以让网站有的安全性。原创先锋在网站制作的时候一定要呈现出拥有非常高标准的安全性,这是一个非常重要的部分,只有网站足够安全,可以用户的信息不被泄露,才可以让他们放心的浏览,也会吸引到更多的用户来浏览网站。

3、吸引目标群体

网站建设的时候一个很重要的目标就是为了吸引住目标群体,因此我们在建设的时候要根据目标人群的审美需求来进行设计,迎合他们的需求来进行网站制作,这样才可以得到更加专业的效果,还可以提高公司的品牌形象、提升美誉度,为用户创造完美的用户体验。

按照以上三个标准肯定可以制作出适合自己企业的网站,同时原创先锋愿意为您答疑解惑,如果有网站建设的问题可以随时咨询我们!