网站收录就是与互联网用户共享网址,网站收录前提是网站首页提交给搜索引擎,蜘蛛才会光顾,每次抓取网页时都会向索引中添加并更新新的网站,站长只需提供顶层网页即可,不必提交各个单独的网页。抓取工具能够找到其他网页。符合相关标准提交的网址,会在1个月内按搜索引擎收录标准被处理。

增加多入口与文章锚链接

在网站优化初期,由于网站的权重比较低甚至没有权重,这时候搜索引擎蜘蛛不可能无限度地去挖掘你网站的东西。你需要尽量把新更新的东西放到首页、栏目等各个重要页面之上,使你的文章增加更多的入口,而这些重要页面也是搜索引擎蜘蛛经常光顾的,看到了这些近更新的东西就会去看看内容是吸引它,吸引的话它就会带走。

网站如何增加收录

网页只有被搜索引擎收录了才有可能被用户检索到。今天讲的是收录的作用、提高收录。

收录的作用

一增加互联网登录入口,提升网站在搜索引擎中的展示次数,为网站带来更多的流量。

二提高网站收录级别,提高网站的权威值,收录量与网站的等级直接挂钩。

三提升网站收录与流量模型,建议网站尽可能原创。

备注:收录的质量

排名的波动是随着收录的数量与收录的质量(给予权重的高与低)的变化而变化的;

收录的质量(权重),会伴随着每次百度的更新而发生变化(原来是高质量的,现在变成低质量的)

增加多入口的方法

内因多入口

1.Sitemap

2.阅读,相关新闻

3.蜘蛛频繁爬行的页面,做链接链向希望收录的页面

4.列表页必须有页码链接(下一页)

5.内容锚文本链接多元化

6.次导航

7.面包屑导航

引导爬行

1.文章质量,网站的更新频率,文章的性质类型

2.培养蜘蛛爬行规律(定时定量)

3.集中更新一个栏目,以点破面;集中推广外链

4.Robots的使用

5.Nofollow

网站结构

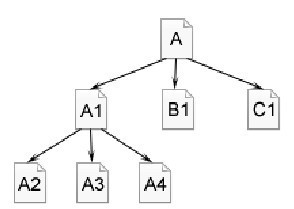

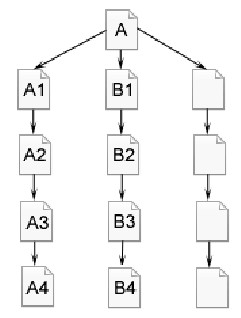

1.减少点击次数,尽量用扁平结构

2.Url

3.确保每个页面都可以通过至少一个文本链接到达

友好度

1.死链

2.Alt的使用

3.H标签的使用

4.减少url动态参数,flash,js,iframe的使用

5.设置TKD

6.利用文字导航

7.页面尽量使用文字,减少图片,table等的使用

8.代码去冗余

9.Canonical标签(强调主次);<link rel=“Canonical” href=”url”>

10.服务器的稳定性

11.域名年龄

12.Meta标签的使用(每个网页应该有一个的标题)

13.详细的网站介绍、联系方式,让用户可以方便的联系

外因

1.外链链向新闻列表

2.提交目录,提交搜索引擎

3.外链数量与质量

4.友情链接

什么是seo ?

SEO(Search Engine Optimization),汉译为搜索引擎优化。搜索引擎优化是一种利用搜索引擎的搜索规则来提高目的网站在有关搜索引擎内的排名的方式。

SEO就是在了解搜索引擎排名算法的基础上,对网站进行站内和站外的优化,对网站存在的弊端加以更正,提高网站关键词在搜索引擎中的排名,获得更多流量与转化率,从而获得盈利。

SEO可分为站外SEO和站内SEO两种。

了解搜索引擎工作原理

站内SEO

站外SEO

排名算法

站长工具

案例分析

搜索引擎工作原理

爬行

抓取

预处理(索引)

排名

搜索引擎自动信息搜集功能分两种。

1、定期搜索,即每隔一段时间,搜索引擎主动派出“蜘蛛”程序,对一定IP地址范围内的互联网站进行检索,一旦发现新的网站,它会自动提取网站的信息和网址加入自己的数据库。

2、提交网站搜索,即网站拥有者主动向搜索引擎提交网址,它在一定时间内(2天到数月不等)定向向你的网站派出“蜘蛛”程序,扫描你的网站并将有关信息存入数据库,以备用户查询。

步:爬行

搜索引擎是通过一种特定规律的软件跟踪网页的链接,从一个链接爬到另外一个链接,像蜘蛛在蜘蛛网上爬行一样,所以被称为“蜘蛛”也被称为“机器人”。搜索引擎蜘蛛的爬行是被输入了一定的规则的,它需要遵从一些命令或文件的内容。

第二步:抓取

搜索引擎是通过蜘蛛跟踪链接爬行到网页,并将爬行的数据存入原始页面数据库。其中的页面数据与用户浏览器得到的HTML是完全一样的。搜索引擎蜘蛛在抓取页面时,也做一定的重复内容检测,一旦遇到权重很低的网站上有大量抄袭、采集或者复制的内容,很可能就不再爬行。

爬行方式

广度优先 深度优先

影响蜘蛛爬行的因素

网站、页面权重高。

网站更新度:蜘蛛每次爬行都会把页面数据储存起来,第二次来的时候发现页面没有变化,就不再抓取。如果页面经常更新,蜘蛛来的也频繁。

导入链接

与首页的点击距离。

是否导出链接过多

是否有网站地图

是否设置404页面

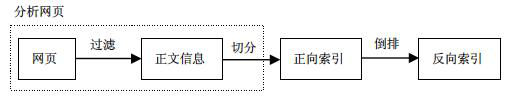

第三步:预处理(索引)

搜索引擎将蜘蛛抓取回来的页面,进行各种步骤的预处理。

1.提取文字(去除格式代码,留文字部分)

2.中文分词

基于词典匹配,词典匹配相对降低,准确性取决于词典的完整性与更新度

基于统计,分析大量的文字样本,统计出字与字相邻出现的概率,几个相邻出现次数越多越可能形成一个词

两种各有优缺点,一般混合使用

3.去停止词

停止词就是那些页面中出现频率很高,却对内容没有任何影响的词,如“的”、“地”、“得”之类的助词,“啊”、“哈”、“呀”之类的感叹词,“从而”、“以”、“却”之类的副词或介词。这些词被称为停止词,因为它们对页面的主要意思没什么影响。搜索引擎在索引页面之前会去掉这些停止词,使索引数据主题更为突出,减少无谓的计算量。

4.消除噪声

绝大部分页面上的一部分内容对页面主题也没什么贡献,比如版权声明文字、导航条、广告等。所以搜索引擎在预处理的过程会把这些无关内容进行消噪处理。

5.去重

同一篇文章重复出现在不同的网站或同网站不同的网址上,搜索引擎不喜欢重复性的内容。

索引前进行识别和删除重复内容;去重方法:选取一部分特征关键词(一般是出现频率高的词),十个左右,计算这些词的数字指纹(MD5算法);特征关键词有任何微小的变化,计算出来的数字指纹都有很大的差距。

6.正向索引

经过以上步骤之后,搜索引擎得到的就是独特的、能反映页面主体内容的、以词为单位的内容。接下来搜索引擎索引过程就是可以提取关键词,按照分词程序划分好的词,把页面转换为一个关键词组成的集合,同时记录每一个关键词在页面上的出现频率、出现次数、格式、位置。这样,每一个页面都可以记录为一串关键词集合,其中每个关键词的词频、格式、位置等权重信息也都会记录在案了。

文件ID | 内容 |

文件1 | 关键词1,关键词2,关键词7,关键词10,…… 关键词L |

文件2 | 关键词1,关键词7,关键词30, ……,关键词M |

文件3 | 关键词2,关键词70,关键词305,……,关键词N |

…… | |

文件6 | 关键词2,关键词7,关键词10,……,关键词X |

…… | |

文件x | 关键词7,关键词50,关键词90,关键词Y |

7.倒排索引

正向索引还不能直接用于排名,因为在搜索某个关键词的时候,排名程序需要扫描所有索引库中的文件,计算相关性,这样的计算量无法满足实时返回排名结果的要求,所以搜索引擎会将正向索引数据库重新构造为倒排索引,把文件对应到关键词的映射转换为关键词到文件的映射,在倒排索引中关键词是主键,每个关键词对应着一系列文件,这些文件中都出现了这个关键词。这样当用户搜索某个关键词是,排序程序在倒排索引中定位到这个关键词,就可以马上找出所有包含这个关键词的文件。

关键词 | 文件 |

关键词1 | 文件1,文件2,文件7,文件58,……,文件 |

关键词2 | 文件l,文件7,文件30,……,文件M |

关键词3 | 文件2,文件70,文件305,……,文件n |

…… | …… |